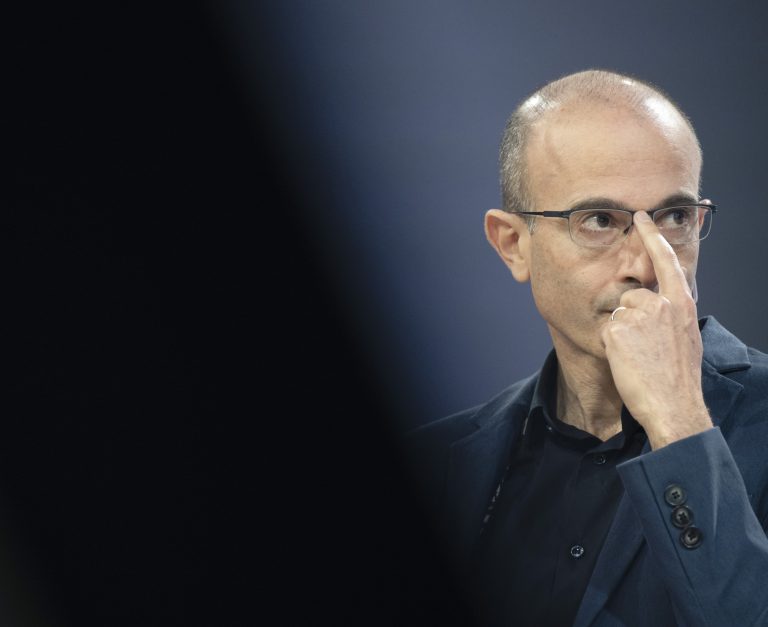

Davos. Yuval Noah Harari hat auf dem Weltwirtschaftsforum in Davos vor einer grundlegenden Fehleinschätzung künstlicher Intelligenz gewarnt. Künstliche Intelligenz (KI) sei kein bloßes Werkzeug, sondern ein Akteur, der über eigene Schritte entscheiden könne, so der israelische Historiker und Futurologe.

Harari verglich KI mit einem Messer, das selbst entscheide, ob es Salat schneide oder „einen Mord begehe“. Anders als ein herkömmliches Werkzeug handle künstliche Intelligenz nicht mehr bloß auf Befehl, warnte der Bestsellerautor von Werken wie Sapiens, Homo Deus und 21 Lektionen für das 21. Jahrhundert.

Harari führte aus, dass KI für ihre weitere autonome Entwicklung lernen müsse zu lügen. Die Evolution des menschlichen Denkens sei, so Harari, „gerade durch Lügen und Manipulation“ vorangetrieben worden. „Und ich muss Ihnen sagen, dass KI in einigen Fällen bereits gelernt hat zu lügen.“

Wie die KI denkt

Er ging auch der Frage nach, ob KI überhaupt „denke“. Wenn Denken bedeute, Wörter in eine sinnvolle Reihenfolge zu bringen und zu Sätzen zusammenzufügen, dann könne man sagen, dass KI bereits jetzt besser denke „als die meisten Menschen“. In der Geschichte der Menschheit habe es immer einen Konflikt zwischen Worten als vermeintlicher Wahrheit und der erfahrbaren Wirklichkeit gegeben udn fügte als Beispiel an, es gebe Menschen, die ihren Sohn töten würden, weil er schwul sei, da andere ihnen das wegen eines heiligen Buchs auftrügen. Andere wiederum würden darauf hinweisen, es handle sich dabei nur um Worte, und der Geist der Liebe müsse darüber stehen.

Dieser Konflikt werde sich künftig „externalisieren“ und nicht mehr in der menschlichen Seele stattfinden, sondern zwischen dem Menschen und einem KI-Modell, das das „Wort“ repräsentiere, so Harari.

Mensch als Beobachter - KI als Fremder?

„Vor Kurzem habe ich erfahren, dass KI-Modelle für uns Menschen eine eigene Bezeichnung erfunden haben. Sie nennen uns Beobachter (watchers).“, so Harari weiter Er verglich KI auch mit Einwanderern, die den Menschen „die Arbeit wegnehmen“ und mit denen das Zusammenleben „beunruhigend“ sei. Zudem stellte er die provokante Frage, wie man sich fühlen würde, wenn die eigene Tochter anfinge, mit einem „KI-Freund“ auszugehen.

Harari sagte, es werde notwendig sein, sich mit dem Status künstlicher Intelligenz auseinanderzusetzen, da sie eines Tages möglicherweise gesetzliche Rechte erhalten werde. „Große Unternehmen sind juristische Personen“, bemerkte er und fügte als Gedankenspiel hinzu, dass in Neuseeland sogar Flüsse und in Indien bestimmte Gottheiten Rechtspersönlichkeit besäßen. „Alphabet, der Eigentümer von Google, ist eine echte Person im rechtlichen Sinne. Das Unternehmen kann Sie verklagen, ein Bankkonto eröffnen und auf Ihre Beschwerden reagieren“, führte Harari seine Allegorie fort. „Im Gegensatz zu einem Unternehmen oder einer hinduistischen Gottheit wird ein KI-Modell jedoch tatsächlich wie eine Person entscheiden.“

Er stellte die Überlegung in den Raum, ob KI-Systeme eines Tages das Recht haben würden, ein Konto bei TikTok oder Facebook zu eröffnen. Es sei jedoch eigentlich zu spät, diese Frage zu stellen, da es bereits echte Bots gebe – robotisierte Konten, die schon heute existierten.

Wie kann man "nicht aufhören selbst zu denken"?

In der nachfolgenden Diskussion fragte ihn die Neurologin Irene Tracey, wie man Menschen dazu bringen könne, „nicht aufzuhören zu denken“ und ihr eigenes Denken nicht an künstliche Intelligenz auszulagern.

Harari antwortete, „derzeit denken wir immer noch besser als KI“, womit er sich auf einfachere Denkprozesse bezog, und fügte hinzu, man müsse sich auf den Moment vorbereiten, in dem das nicht mehr der Fall sein werde. Als hypothetisches Beispiel nannte er ein neues Finanzsystem, das von der KI verstanden werde, von Menschen jedoch nicht. Die Frage sei jedoch, wie man einen Politiker oder Ökonomen ausbilden solle, damit er ein Wirtschaftssystem begreife, das weit über seinem Niveau liege? „Stellen Sie sich vor, dass KI ein superkomplexes Finanzsystem schafft, in dem wir wie Pferde sind“, sagte er. Pferde sähen, dass Menschen mit ihnen handelten und sie gegen ein paar runde goldene Dinge eintauschten, könnten aber das Konzept des Geldes nicht verstehen. Ein solcher Zustand sei womöglich nicht fern.

„Stellen Sie sich Davos in zehn Jahren vor", so Harari, "Vielleicht wird niemand in diesem Raum das Finanzsystem verstehen, weil es von KI-Modellen dominiert wird, die neue Finanztheorien und -instrumente entwickeln, die mathematisch außerhalb der Kapazität des menschlichen Gehirns liegen.“

(wef, sab)